Wie Künstliche Intelligenz (KI) auf junge Menschen wirken kann, ist zurzeit auf der Kurzvideo-App TikTok zu sehen. Eine neuer Filter, den jeder auf sein Handy laden kann, macht aus normalen Menschen makellose, idealisierte Schönheiten. Die erste Reaktion auf die eigene Verwandlung ist meist der verblüffte Ausruf, wie perfekt man doch aussehen könnte. Auch bei Sprechen und Mimik bleibt die Illusion erhalten.

Mitunter folgt dann die Rückverwandlung, indem der Filter weggeschaltet wird: „Und so sehe ich wirklich aus!“ Man spürt Enttäuschung, Unzufriedenheit mit den eigenen Makeln, sieht mitunter sogar Tränen. Oft hört man aber auch Warnungen: Leute, nutzt diesen Filter nicht! Er ist nicht gesund für die Psyche.

Bereits jetzt herrscht in großen Teilen vor allem der jungen Generationen die Auffassung vor, das Normale sei eine Art Makel. Tausende junger Menschen präsentieren in den sozialen Medien perfekte Styles, antrainierte Muskeln und ideale Po-Formen (Brazilian Butt). Nicht wenige sind unzufrieden mit sich selbst, leiden unter psychischen Problemen und Krankheiten wie Magersucht.

Wie soll man noch wissen, wer einem da gegenübersteht?

Mit der Nutzung von KI könnten sich diese Probleme verschärfen, weil es noch schwerer wird, zu unterscheiden, was normal und was idealisiert ist. Man denke nur an Selbstdarstellungen auf sogenannten Dating-Apps. Wer steht einem da gegenüber? Kann man Menschen überhaupt noch vertrauen? Denn durch KI verschmilzt die reale Welt immer stärker mit virtuellen Welten. Und das bringt neben großen Chancen auch große Risiken mit sich.

Es geht hier gar nicht darum, sich gegen solche Technologien zu stemmen, denn Neuerungen wie Buchdruck, Eisenbahn, Auto, Flugzeug, Raumfahrt und Internet haben sich ja auch durchgesetzt, obwohl Leute davor warnten oder behaupteten, dass dies alles ohnehin nicht käme. Und die KI bietet ja auch unglaubliche Chancen, etwa in der Medizin, wenn der Chirurg während der OP dreidimensionale Bilder des Körperinneren erhält (augmented reality). Oder in der Bildung, wenn man mit VR-Brille ins alte Rom oder ins Universum reist.

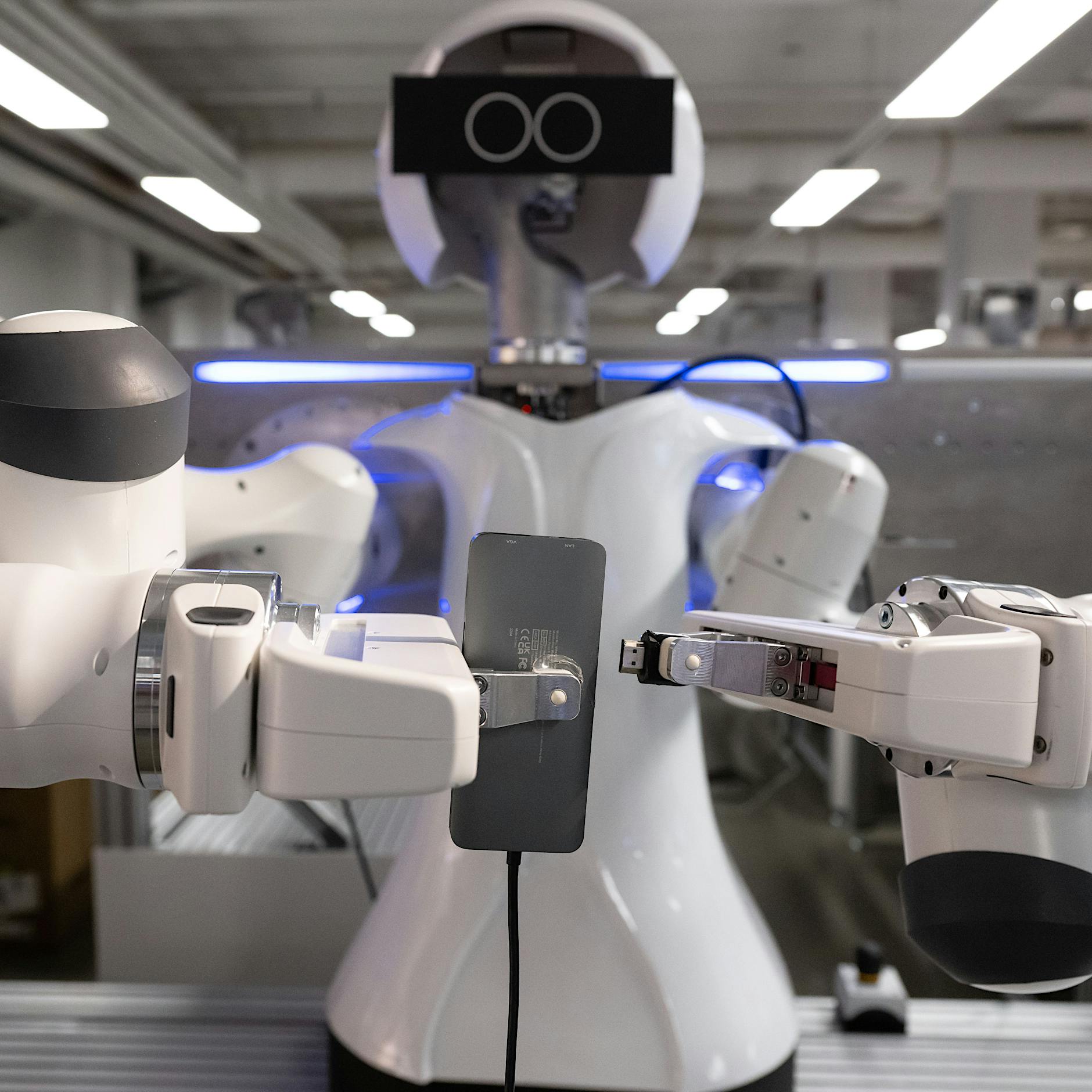

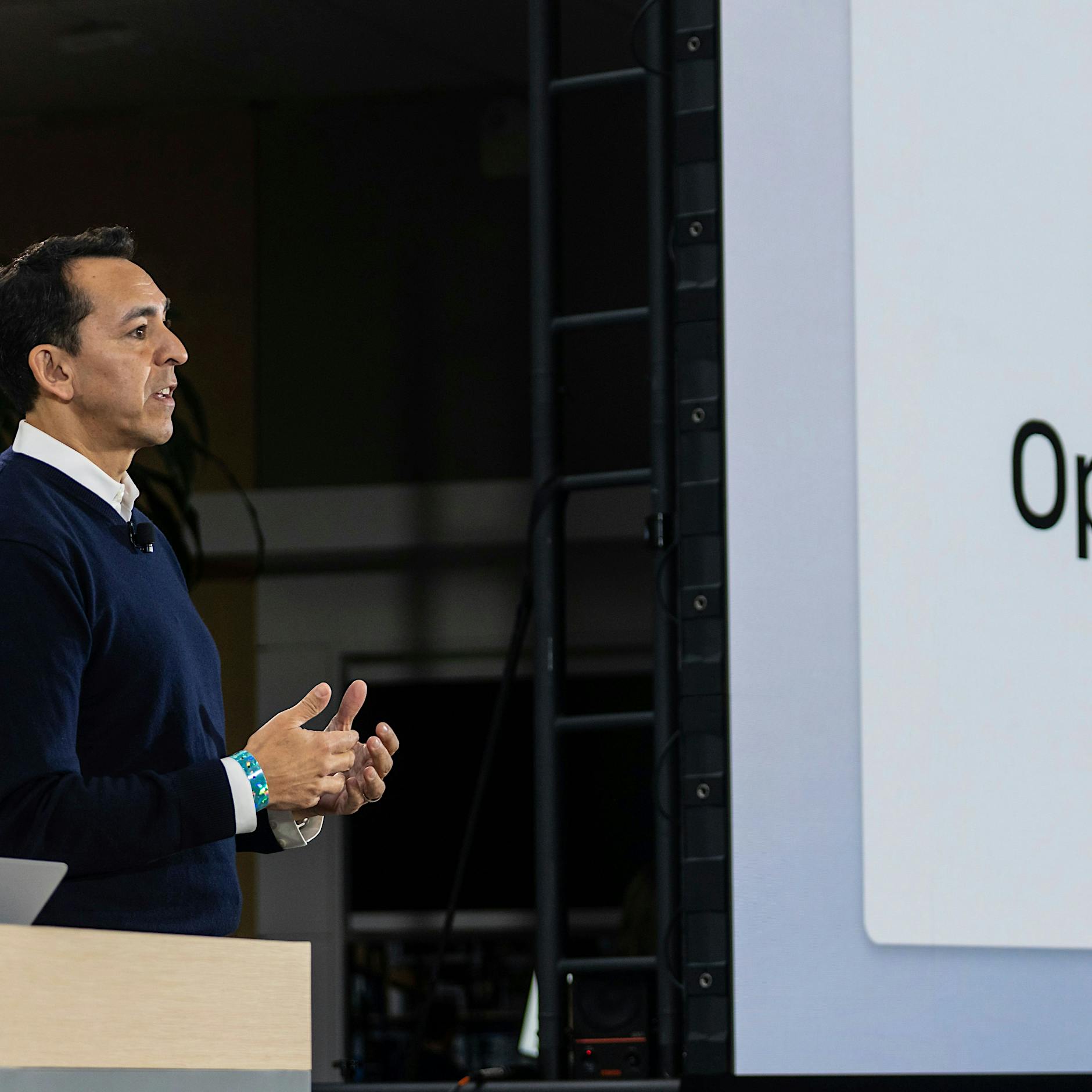

KI soll vieles möglich machen: Home-Learning, intelligente Tutorsysteme, automatisiertes Fahren, blitzschnelle Datenauswertung und Entscheidungen, die Übernahme von Routine-Aufgaben in der Arbeitswelt. Erst vor einigen Wochen wurde zum Beispiel das neue KI-Sprachmodell ChatGPT der Entwicklerfirma Open AI präsentiert. Es kann selbst recherchieren, Artikel, Reden und sogar Gedichte verfassen.

Sprachmodell erfindet wissenschaftliche Quellen, die es nicht gibt

Viele Menschen nutzen ChatGPT im Internet gerade als Spielerei. Zugleich hört man fast nebenbei, das Sprachmodell habe an US-Universitäten bereits Prüfungen in Jura, Medizin und Wirtschaftswissenschaft bestanden. Oder es erfinde bei wissenschaftlichen Arbeiten Quellen, die gar nicht existieren.

Wie immer ist die technische Entwicklung viel schneller als die Debatte über die Risiken. Gerade erst hat der Deutsche Ethikrat eine fast 290-seitige Stellungnahme herausgegeben, in der es unter anderem heißt: Künstliche Intelligenz muss den Menschen bei seiner Entfaltung dienen und darf ihn nicht behindern oder ersetzen. Doch was werden Unternehmen tun, wenn sie Arbeitskräfte einsparen können?

Bereits jetzt gibt es Listen von Jobs, die künftig durch KI ersetzt werden könnten – vom U-Bahn- und Taxifahrer über den Hotel-Rezeptionisten bis zum Radiologen. Andere sagen, dass KI dem Menschen vor allem helfen und ihn unterstützen werde. Der Mensch werde bleiben, denn eine Maschine sei eben nicht empathisch und verfüge nicht über soziale Intelligenz.

Im Grunde müssen Bildungsinhalte umgekrempelt werden

Besonders schwerwiegend ist aber die Frage, was mit der Bildung und der öffentlichen Kommunikation passiert. Wenn das oberste Ziel von Bildung ist, „den Menschen zu einer mündigen und freien, und das heißt einer zur Verantwortung fähigen Person heranzubilden“, wie der Ethikrat schreibt, dann geht es doch zuallererst darum, ihn zur Orientierung in einer komplexen Welt zu befähigen. Wie kann man mündig und frei sein, wenn man nicht mehr weiß, was wahr und richtig ist – und was „Fake“? Siehe die Gesichtsfilter und die erfundene Quellen durch ChatGPT.

Im Grunde müssten die Inhalte der Bildung umgekrempelt werden, hin zu einer aktiven Auseinandersetzung mit wesentlichen Fragen, bei denen es nicht nur darum geht, wie man mit digitalen Medien und KI technisch umgeht und was diese leisten können. Sondern, was zur Orientierung wichtig ist.

Zu solchen Fragen könnte gehören: Wie kann man in Medien Wahres von „Fake“ unterscheiden? Welche Risiken stecken in KI-Sprachmodellen und wie gehe ich damit um? Wie finde ich heraus, welche Quellen seriös sind und welche nicht? Wie finde ich evidente Aussagen? Welche Streitregeln gibt es? Was kann man alles machen, ohne das Handy zu benutzen? Was bedeutet psychische Gesundheit? Wie verändern sich Schönheitsideale? Was ist „normal“ und wie sollte man mit seinem Körper umgehen?

Niemand ist davor gefeit, auf einen echten „Fake“ hereinzufallen

Die Schulen sind natürlich heillos überfordert damit. Zumal es ja bereits jetzt schwer ist, in den Medien zu erkennen, was wahr und was falsch ist. Vieles ist ohnehin sehr widersprüchlich. Das zeigen Themen wie Corona, Klimawandel und Ukraine-Krieg. In der Bildung kann man sicher mit bestimmten Fakten gegenhalten – wenn man im stressigen Schulalltag überhaupt dazu kommt. Aber die Welt ist zu vielfältig, die Themen zu breit, um in der Schule auch nur annähernd Grundlagen zu legen. Es sei denn, die generelle Grundlage für Bildung wird die Marxsche Devise „An allem ist zu zweifeln“.

Wie man sieht, ist niemand davor gefeit, selbst auf einen echten „Fake“ hereinzufallen. Ein Beispiel dafür ist, wie vor einiger Zeit Politiker in Berlin, Budapest, Madrid, Warschau und Wien Opfer gefälschter Video-Anrufe wurden. Sie glaubten, mit dem ukrainischen Politiker Vitali Klitschko zu sprechen. Dabei hatte ein russisches Comedy-Duo die Anrufe „gefaked“, und das noch nicht mal gut, wie Technik-Insider sagen. Statt eines „Deep Fakes“ sei es ein „Cheap Fake“ gewesen. Aber dennoch wirksam.

Die Risiken, ja der bewusste Missbrauch von KI müssen Thema der gesamten Gesellschaft sein. Es geht nicht nur um die Frage, was technisch möglich ist, sondern auch um das, was sinnvoll und überhaupt noch gesellschaftlich beherrschbar ist. Vor allem braucht es Kontrolle und Regeln, und zwar auch für die Entwickler von Apps, Sprachmodellen, virtuellen Spielen und anderem. Diese Regeln müssen verbindlich sein.

Es braucht klare Regeln für die Entwickler von Künstlicher Intelligenz

Ein Beispiel dafür ist die Kurzvideo-App TikTok, mit der sich täglich Millionen junge Leute weltweit beschäftigen. Sie gehört zum chinesischen Bytedance-Konzern. Und sie krempelt jetzt aufgrund von wachsendem politischen Druck – vor allem in den USA – ihr Regelwerk um. So sollen zum Beispiel Videos, die von KI-Software erzeugte Figuren oder Objekte beinhalten, klar gekennzeichnet werden. Verboten soll es sein, reale Privatpersonen mit Computer-Darstellungen zu imitieren.